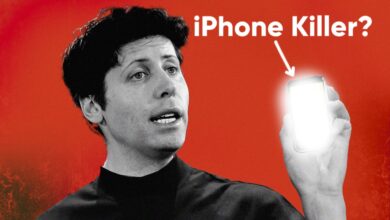

سم آلتمن، مدیرعامل OpenAI اعلام کرد که این استارتاپ بهعنوان بخشی از برنامههای ایمنی محصولات خود، مدل هوش مصنوعی بعدیاش را ابتدا در اختیار موسسه ایمنی هوش مصنوعی ایالات متحده قرار خواهد داد.

طبق گزارش تککرانچ، در حال حاضر نگرانیهایی وجود دارد مبنی بر اینکه OpenAI بیشتر به دنبال توسعه مدلهای هوش مصنوعی قدرتمند است و به همین دلیل ایمنی را در اولویتهای خود قرار نمیدهد.

آلتمن در پستی در ایکس (توییتر سابق) درباره اهمیت ایمنی برای OpenAI میگوید:

«همانطور که در ژوئیه گذشته نیز اعلام کردیم، ما متعهدیم که حداقل ۲۰ درصد از منابع محاسباتی خود را به تلاشهای مرتبط با ایمنی در کل شرکت اختصاص دهیم. تیم ما در حال توافق با موسسه ایمنی هوش مصنوعی ایالات متحده است تا دسترسی زودهنگام به مدل پایه بعدیمان را برای آنها فراهم کند. ما برای این همکاری بسیار هیجانزده هستیم!»

در ماههای گذشته، گزارش شده بود که OpenAI واحدی را که روی ایمنی سیستمهای هوش مصنوعی کار میکرد، منحل کرده است. این اقدام باعث شد تا دو نفر از رهبران این استارتاپ، «جان لیکه» که اکنون تحقیقات ایمنی استارتاپ هوش مصنوعی آنتروپیک را رهبری میکند و «ایلیا سوتسکور» که شرکت هوش مصنوعی متمرکز بر ایمنی خود با نام Safe Superintelligence را تأسیس کرده است، از OpenAI جدا شوند.

موسسه ایمنی هوش مصنوعی در اوایل سال جاری میلادی توسط موسسه ملی استاندارد و فناوری (NIST) تأسیس شد. در وبسایت NIST، هدف این موسسه «توسعه دستورالعملها و استانداردهای علمی و تجربی برای ارزیابیها و سیاستهای هوش مصنوعی و ایجاد پایهای برای ایمنی هوش مصنوعی در سراسر جهان» بیان شده است.